警惕算法分發(fā) 便捷背后隱藏的互聯(lián)網(wǎng)信息風險

在當今數(shù)字時代,算法分發(fā)已成為互聯(lián)網(wǎng)新聞信息服務的主流模式。它通過分析用戶行為、偏好和社交關(guān)系,精準推送個性化內(nèi)容,極大地提升了信息獲取的效率和體驗。從新聞資訊、短視頻到社交媒體,算法無處不在,仿佛一位“智能管家”,為我們篩選著海量信息。在這份便捷與智能的背后,一系列潛在的風險與挑戰(zhàn)正悄然滋生,亟待我們清醒認識和審慎應對。

一、信息繭房:認知的窄化與固化

算法最核心的風險在于其可能強化“信息繭房”效應。系統(tǒng)傾向于持續(xù)推薦用戶感興趣或認同的內(nèi)容,長期沉浸其中,用戶接觸的信息面會變得越來越狹窄,如同作繭自縛。這不僅限制了人們對世界多元、復雜面貌的認知,還可能加劇觀點和立場的極化。當不同群體沉浸在各自的信息孤島中,彼此的理解與對話將變得愈發(fā)困難,社會共識的構(gòu)建面臨挑戰(zhàn)。

二、內(nèi)容質(zhì)量失衡:流量至上與價值失位

算法的優(yōu)化目標往往是用戶 engagement(參與度),如點擊率、觀看時長、轉(zhuǎn)發(fā)評論等。這容易導致平臺和內(nèi)容創(chuàng)作者為了獲取流量而迎合算法偏好,大量生產(chǎn)標題黨、情緒化、低質(zhì)甚至虛假的信息,因為這類內(nèi)容通常更容易引發(fā)強烈反應。嚴肅、深度、需要理性思考的優(yōu)質(zhì)內(nèi)容,反而可能在流量競爭中處于劣勢,造成“劣幣驅(qū)逐良幣”的現(xiàn)象,侵蝕互聯(lián)網(wǎng)信息生態(tài)的健康根基。

三、隱私安全與數(shù)據(jù)濫用

算法的精準運行高度依賴對用戶數(shù)據(jù)的收集、分析和畫像。這涉及深度的隱私采集,包括瀏覽歷史、地理位置、社交關(guān)系乃至設(shè)備信息等。一旦數(shù)據(jù)保護不力或被不當濫用,用戶不僅面臨隱私泄露的風險,其個人信息還可能被用于精準的商業(yè)操縱、價格歧視,甚至在極端情況下影響社會輿論和個體決策,構(gòu)成對個人自主性的隱形侵害。

四、價值觀與意識形態(tài)的隱形塑造

算法并非完全中立的技術(shù)工具。其設(shè)計邏輯、權(quán)重設(shè)置、訓練數(shù)據(jù)都蘊含著設(shè)計者和平臺方的價值判斷。通過決定“哪些信息被看見”、“以何種順序和頻率呈現(xiàn)”,算法在無形中塑造著用戶關(guān)注的話題、看待問題的角度乃至價值觀念。如果缺乏有效的監(jiān)督與平衡,單一的商業(yè)邏輯或特定傾向可能通過算法被無限放大,對公共議程和社會文化產(chǎn)生深遠影響。

五、主體責任模糊與監(jiān)管挑戰(zhàn)

在算法分發(fā)的模式下,傳統(tǒng)“編輯”的把關(guān)責任在一定程度上轉(zhuǎn)移給了自動化系統(tǒng)。當出現(xiàn)低俗、虛假、侵權(quán)或有害信息時,平臺常以“技術(shù)中立”或“僅提供分發(fā)服務”為由規(guī)避責任。算法的“黑箱”特性也使得其決策過程不透明、難解釋,給監(jiān)管和問責帶來了巨大技術(shù)難度與法律挑戰(zhàn)。如何界定平臺在算法推薦中的主體責任,成為全球性的治理難題。

應對與展望:走向負責任的算法時代

面對這些風險,我們并非無能為力。邁向更健康的信息生態(tài),需要多方協(xié)同努力:

- 平臺責任強化:互聯(lián)網(wǎng)企業(yè)應提升算法透明度,建立人工干預和糾偏機制,優(yōu)化算法價值導向,平衡商業(yè)目標與社會責任,優(yōu)先推薦優(yōu)質(zhì)、可信、多元的內(nèi)容。

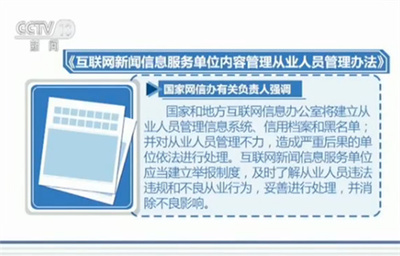

- 監(jiān)管法規(guī)完善:政府需建立健全適應算法時代的法律法規(guī),如明確算法備案、透明性要求、主體責任,并對數(shù)據(jù)收集使用劃定更清晰的紅線。

- 用戶素養(yǎng)提升:作為個體,我們應培養(yǎng)自身的媒介素養(yǎng)和信息鑒別能力,主動“破圈”,有意識地接觸不同來源、不同觀點的信息,保持開放和批判性思維。

- 技術(shù)創(chuàng)新向善:鼓勵開發(fā)更注重內(nèi)容質(zhì)量、多樣性、公共價值的算法模型,探索“人機協(xié)同”的審核與推薦模式。

算法分發(fā)是技術(shù)進步賜予我們的利器,但它絕非沒有代價的禮物。唯有清醒認識其雙刃劍本質(zhì),通過有效的治理、企業(yè)的自律與公眾的自覺,才能駕馭好這股強大的技術(shù)力量,使其真正服務于信息傳播的豐富、多元與真實,賦能一個更加清朗、理性、包容的數(shù)字公共空間。

如若轉(zhuǎn)載,請注明出處:http://www.bgjygugn.cn/product/67.html

更新時間:2026-04-08 22:57:33